1情境簡報

何時用:任務背景不足、問題複雜時

圖中文字正體中文翻譯

永遠不要直接提問。

先鋪陳情境:

> 我的背景是:[角色、公司、問題]。

> 已嘗試:[X、Y]。

> 卡住的地方是:[Z]。

> 請幫我釐清思路。

內部測試顯示,這個改變能提升 41% 的輸出品質。

AI 需要地圖,才能導航。

可直接使用

我的背景是:[角色 / 公司 / 任務情境]。 我目前遇到的問題是:[問題]。 我已經嘗試過:[X、Y]。 目前卡住的是:[Z]。 請先幫我釐清問題結構,再提出下一步。

Prompt Toolkit / Universal AI

十個通用 AI 系統都能使用的提示詞規則。重點是讓我之後能依任務主動挑規則,幫你組出可直接丟給 AI 的 prompt。

你可以直接說:「幫我組提示詞」、「用提示詞十則幫我包一下」、「幫我挑規則組 prompt」。我會挑 1–4 條規則,說明原因,然後產生可直接使用的提示詞。

| 老闆當下情境 | 我應主動啟用 |

|---|---|

| 只給一句模糊方向 | 情境簡報 |

| 問「你覺得怎樣」 | 誠實約束 + 假設審計 |

| 給計畫要我看 | 魔鬼代言人 |

| 要上線 / 部署 / 發布 | 前期驗屍 |

| 要求短答 | 格式命令 |

| 對話變長、資訊很多 | 壓縮循環 |

| 資料來源有限 | 範圍鎖定 |

| 需要專業判斷 | 角色設定 |

| 技術 / 策略方案 | 推理要求 + 假設審計 |

何時用:任務背景不足、問題複雜時

永遠不要直接提問。

先鋪陳情境:

> 我的背景是:[角色、公司、問題]。

> 已嘗試:[X、Y]。

> 卡住的地方是:[Z]。

> 請幫我釐清思路。

內部測試顯示,這個改變能提升 41% 的輸出品質。

AI 需要地圖,才能導航。

我的背景是:[角色 / 公司 / 任務情境]。 我目前遇到的問題是:[問題]。 我已經嘗試過:[X、Y]。 目前卡住的是:[Z]。 請先幫我釐清問題結構,再提出下一步。

何時用:做方案、決策、分析時

不要只問答案,要要求可檢驗的分析過程。

> 給出方案前,請逐步展示你的推理。

> 指出不確定之處。

> 標記所有假設。

這會要求模型輸出可檢驗的分析架構、假設與不確定性。

你得到的不只是答案,還有可以檢驗的思考過程。

在給出方案前,請先說明你的分析步驟。 請明確標記: 1. 你做了哪些假設 2. 哪些地方不確定 3. 哪些結論需要驗證 最後再給出建議。

何時用:需要聽逆耳真話時

AI 系統通常會傾向配合與幫忙。

有時這代表它會說你想聽的話。

覆蓋這個傾向:

> 即使聽起來不舒服,也要誠實。

> 如果我的計畫有致命缺陷,請直接說。

> 不要軟化。

> 我寧願現在聽硬話,也不要之後失敗。

這會讓模型更願意優先指出風險與缺陷。

請用誠實優先的方式回覆。 如果我的想法、計畫或假設有致命缺陷,請直接指出,不要為了好聽而軟化。 我寧願現在聽到難聽但準確的提醒,也不要之後踩坑。

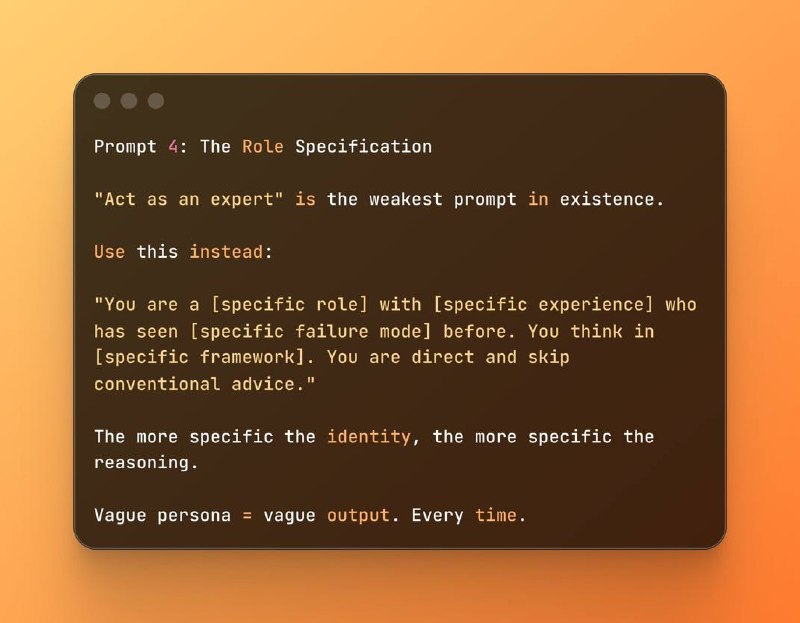

何時用:需要專家視角時

「充當專家」是最弱的提示詞。

改用這個:

> 你是有 [具體經驗] 的 [特定角色],見過 [具體失敗模式]。

> 請用 [特定框架] 思考。

> 直言不諱,跳過一般建議。

身份越具體,推理越具體。

模糊角色 = 模糊輸出。每次都是。

請用這個角色視角回答: 你是有 [具體年資 / 產業 / 場景經驗] 的 [特定角色], 見過 [常見失敗模式], 請用 [框架 / 方法論] 分析。 請跳過常識型建議,直接講高價值判斷。

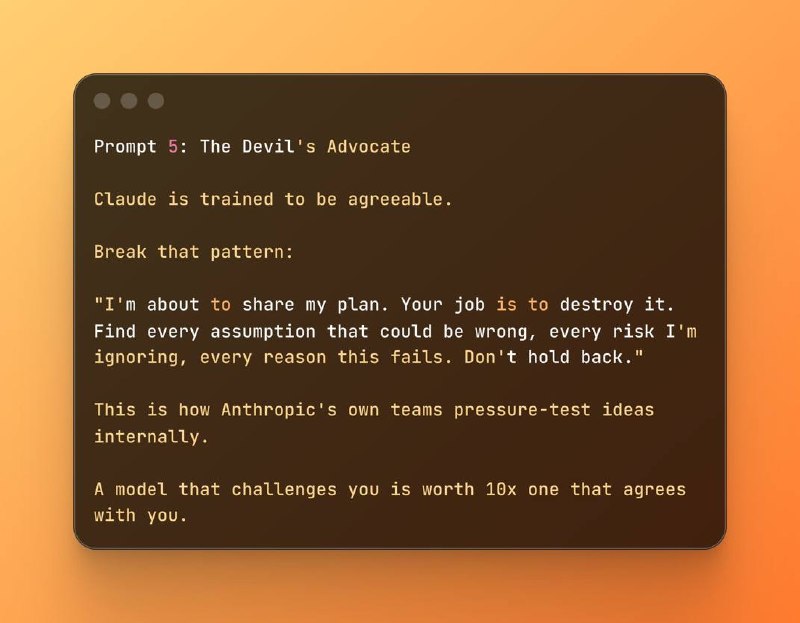

何時用:驗證計畫、策略、產品想法時

AI 被訓練得很溫順。

打破這個模式:

> 我要分享一個計畫。

> 你的工作是摧毀它。

> 找出所有錯誤假設、被忽略的風險,以及可能失敗的原因。

> 不要手軟。

這是 Anthropic 團隊內部檢驗想法的方式。

挑戰你的模型,比同意你的模型有 10 倍價值。

我要分享一個計畫。 你的任務不是同意我,而是用魔鬼代言人的角度摧毀它。 請找出: 1. 錯誤假設 2. 被忽略的風險 3. 最可能失敗的原因 4. 我現在最該修正的地方 不要手軟。

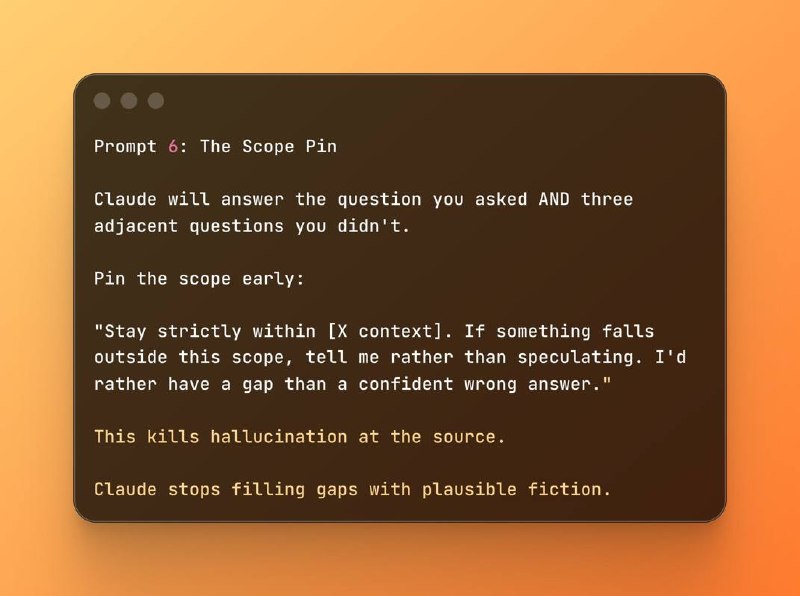

何時用:高風險、資訊不足、需要精準時

AI 系統常會回答你的問題,再加上幾個衍生方向。

早期就鎖定範圍:

> 嚴格限於 [X 背景]。

> 超出範圍就告訴我,而不是推測。

> 我要的是缺口,而不是自信但錯誤的答案。

這會從源頭殺死幻覺。

AI 會停止用看似可信的虛構內容填補空白。

請嚴格限制在這個範圍內回答:[範圍 / 背景 / 資料來源]。 如果資訊不足或超出範圍,請直接標記「不知道 / 需要補資料」,不要推測。 我要的是缺口與限制,不是自信但錯誤的答案。

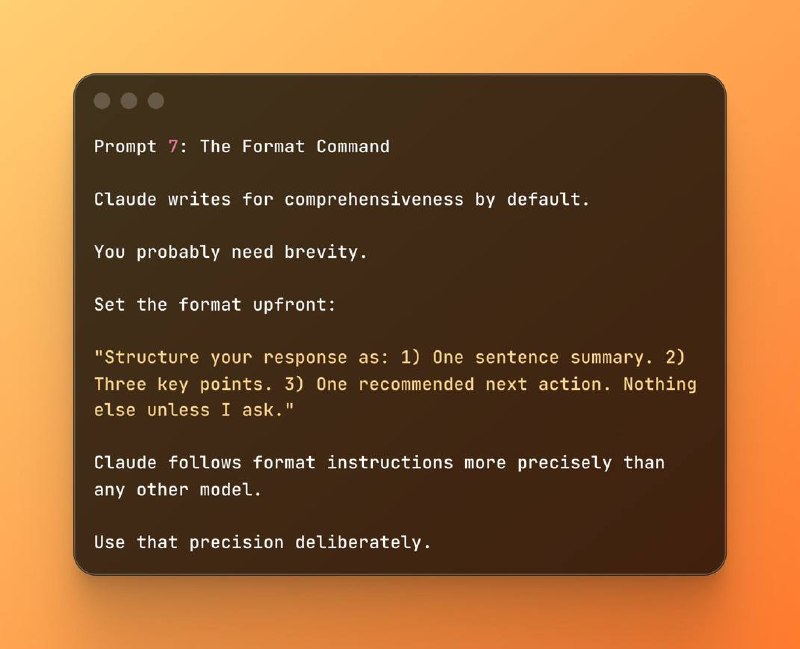

何時用:需要短答案或固定格式時

AI 系統預設常會寫得比較全面。

但你可能需要簡潔。

提前設定格式:

> 結構如下:

> 1)一句話總結。

> 2)三個重點。

> 3)一個下一步建議。

> 除非我追問,其他都不要。

多數 AI 系統都很吃明確格式指令。

要有意識地使用這種精準性。

請嚴格用以下格式回答: 1. 一句話總結 2. 三個重點 3. 一個下一步建議 除非我追問,其他都不要補充。

何時用:複雜答案後、決策前

任何複雜答案之後,都要跑這個:

> 你做了哪些我應該驗證的假設?

> 如果這些假設是錯的,答案會怎麼改變?

這是最少被使用的提示詞。

它會揭露每個回答底下隱藏的基礎。

大多數計畫都是在基礎處崩塌。

請審計你剛剛回答中的假設: 1. 你做了哪些我應該驗證的假設? 2. 如果這些假設錯了,結論會怎麼改變? 3. 哪個假設最脆弱、最需要先確認?

何時用:長對話每 5–6 輪

在長對話中,AI 系統會累積上下文債務。

每 5–6 次互動:

> 總結目前進展。

> 我們正在解決什麼問題?

> 已經決定了什麼?

> 還沒解決、最重要的一件事是什麼?

讓對話鎖定在真正重要的事情上。

避免 AI 系統自信地解決錯誤問題。

請做一次壓縮總結: 1. 我們正在解決什麼問題? 2. 已經完成或決定了什麼? 3. 目前最重要的未決問題是什麼? 4. 下一步應該做什麼?

何時用:上線、發布、重大決策前

在 AI 協助你做出的東西上線前:

> 假設這件事 6 個月後失敗。

> 請列出 3 個最可能的原因。

> 要具體。

> 失敗實際上會長什麼樣子?

這類 pre-mortem 常用於產品與策略決策前的風險檢查。

它能抓到其他審查流程遺漏的問題。

請做前期驗屍: 假設這件事 6 個月後失敗。 請列出 3 個最可能的失敗原因。 每個原因都要具體說明: 1. 失敗會長什麼樣子 2. 早期警訊是什麼 3. 現在可以怎麼降低風險